你的监控系统,是在“制造警报”还是在“生产洞察”?

凌晨三点,运维工程师的手机屏幕又一次被相同的告警信息点亮:“服务器CPU使用率超过85%”。这是本周第七次了。他熟练地登录系统,执行那套已经形成肌肉记忆的操作:检查进程、清理缓存、重启服务。二十分钟后,告警解除,一切恢复“正常”。而他清楚地知道,同样的问题下周还会再来。

在无数个运维团队中,这个场景日复一日地上演。我们的监控仪表盘越来越炫酷,告警渠道从邮件扩展到短信、Slack、钉钉,然而奇怪的是,团队的运维压力并未减轻,反而陷入了一种 “告警疲劳—应急处理—告警再临” 的恶性循环。数据显示,现代运维团队平均每天需要处理数百条甚至上千条告警,而其中高达90% 的告警要么是误报,要么根本不需立即干预。

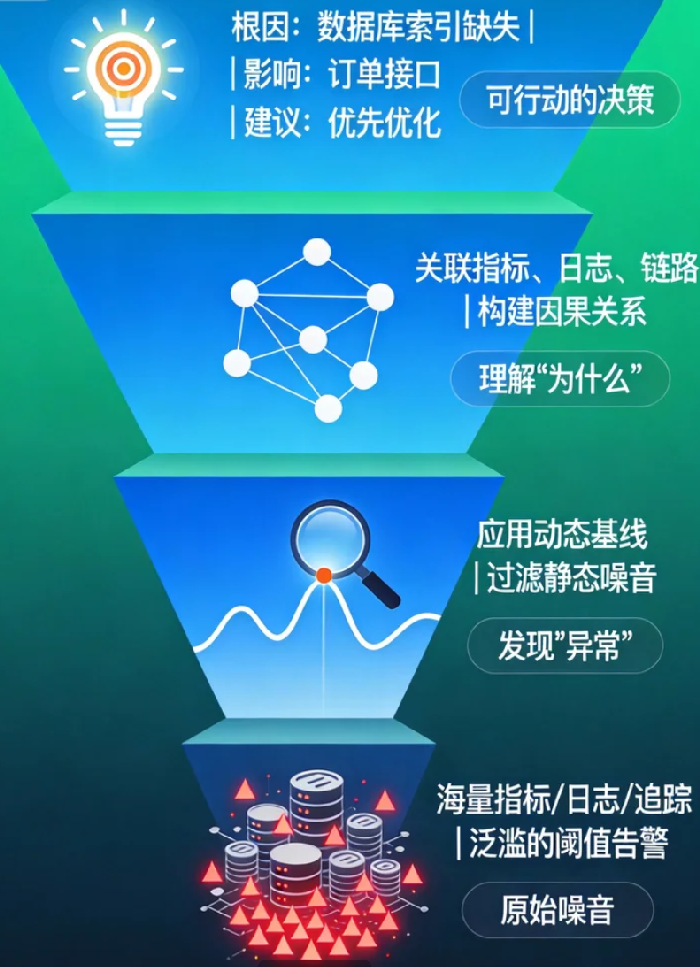

问题出在哪里?我们的监控系统似乎变成了一个勤奋但盲目的“报童”,不断把各种信息扔到我们面前,却从不告诉我们这些信息究竟意味着什么。我们拥有了海量的“数据”,却严重缺乏真正的“洞察”。是时候重新审视一个根本性问题了:我们部署监控,究竟是为了收集告警,还是为了理解系统并预见问题?

01 告警与洞察:表象与本质的差距

要打破这个循环,我们首先要区分两个核心概念:告警 和 洞察。

告警是一个简单的事实陈述:“CPU使用率达到90%”、“服务响应时间超过2秒”、“磁盘空间不足80%”。它描述的是一个已经发生或正在发生的异常状态。告警是必要的,但它只回答了“什么”在发生。

洞察则更进一步。它是基于上下文、趋势和关联分析得出的理解:“因为昨晚部署的新版本存在内存泄漏,导致Java进程内存使用每小时增长5%,预计在明天上午10点前后会触发OOM(内存溢出)崩溃,影响核心下单接口。” 洞察回答的是“为什么”会发生,以及“接下来会怎样”。

绝大多数监控系统停留在“告警工厂”阶段的原因,在于它们被设计为基于静态阈值的规则触发器。当CPU>85%,触发告警;当错误率>0.1%,触发告警。这种模式有两个致命缺陷:

缺乏上下文感知:一次促销活动带来的流量洪峰,与一次DDoS攻击带来的流量洪峰,在监控指标上可能一模一样,但对业务的意义和所需的响应却天差地别。静态阈值无法区分“好的繁忙”与“坏的繁忙”。

治标不治本:处理“CPU高”告警,通常的作法是重启或扩容。这就像用止痛药治疗发烧——缓解了症状,却忽略了体内的感染。真正的“洞察”会引导我们去寻找导致CPU高的根本原因:是低效的数据库查询?还是失控的循环?或是垃圾回收机制配置不当?

02 从“可监控性”到“可观测性”的范式跃迁

要生产洞察,我们需要一场思维范式的根本转变:从追求 “可监控性” 转向构建 “可观测性”。

可监控性:是我们预设问题的能力。我们提前猜想系统可能会在A、B、C处出问题,然后在A、B、C处放置探针(监控项)。它的核心局限是:你只能发现你预先想到的问题。 对于未知的、意外的故障模式,它束手无策。

可观测性:是我们解释任何未知状态的能力。它不依赖于预设问题,而是通过收集系统产生的所有遥测数据——主要包括三大支柱:指标、日志、链路追踪——并能够自由地探索、关联这些数据,来回答任何临时提出的问题。

用一个比喻来说:传统的监控就像在迷宫里安装摄像头(预设监控点),你只能看到摄像头拍到的地方。而可观测性则是给迷宫里扔进一只会实时绘制全景地图并回答你问题的智能老鼠,你可以问它:“我现在在哪?怎么去出口?刚才谁经过了这里?”

指标告诉我们系统的“健康状况”(如CPU、内存、QPS)。

日志记录了系统的“离散事件”和“执行细节”(如错误堆栈、用户行为)。

链路追踪描绘了请求穿越复杂分布式系统的“完整旅程”。

只有当这三者被有机地关联、统一在一个上下文中时,我们才能将一个孤立的告警(“API超时率高”),转化成一个深刻的洞察(“因为下游的支付服务数据库查询变慢,拖累了整个订单链路的响应时间,根本原因是数据库索引缺失”)。

03 构建“洞察生产流水线”的四步实践

理论之后,是行动。如何将一个“告警制造机”改造为“洞察生产系统”?以下是四个关键的实践步骤。

第一步:实施统一的遥测数据收集与关联

行动:摒弃烟囱式的监控工具。采用OpenTelemetry这样的开源标准,对应用进行无侵入或低侵入的埋点,自动收集链路、指标和日志。确保每个请求都有一个唯一的 Trace ID,并像“遗传基因”一样,贯穿于这个请求生命周期内产生的所有指标和日志中。

工具提示:考虑使用如Prometheus(指标)、Loki或Elasticsearch(日志)、Jaeger或Zipkin(链路)等开源生态,或采用Datadog、New Relic等商业一体化方案。

第二步:用动态基线替代静态阈值

行动:对核心业务指标(如响应时间、错误率、订单量)应用机器学习算法,计算其动态基线。系统不再在“响应时间>200ms”时告警,而是在“响应时间显著偏离其过去7天相同时段的正常波动范围”时告警。

反常规视角:有时,指标“过于正常”也可能是异常。例如,在“双十一”零点,订单量曲线如果完全平稳,那一定是出了比系统崩溃更严重的问题(可能是流量入口被误封)。动态基线模型能更好地捕捉这类“该高不高,该低不低”的异常。

第三步:构建因果关系图谱,实现告警降噪与根因定位

行动:利用服务依赖关系、基础设施拓扑等信息,构建系统的“因果关系图谱”。当一个告警触发时,系统能自动分析:是哪个上游服务引发了当前服务的故障?这个故障又可能影响哪些下游服务?

效果:这将实现“告警风暴”到“根因告警”的收敛。你不再收到100个相关服务的红色告警,而只会收到1条明确指出“根因在于数据库主库宕机”的精准洞察,并附带其影响范围的评估。

第四步:从“事后追溯”到“事前预测”

行动:这是洞察生产的最高阶形态。通过对历史指标趋势、事件日志、变更记录进行综合分析,训练预测模型。

场景:系统可以提示:“根据当前内存泄漏趋势和排期,预测该服务将在36小时后达到内存阈值,建议在下次常规发布时优先修复此缺陷。”或者:“识别到本次代码提交的模式,与历史上三次引发严重故障的提交高度相似,建议进行额外评审。”

04 衡量成功:从MTTR到“洞察时间”与“决策质量”

最后,我们需要改变衡量运维团队成功的标准。传统的 “平均修复时间” 是一个充满误导性的指标。它奖励的是“手速快”的急救员,而非“防患于未然”的工程师。

我们应该转而关注:

平均洞察时间:从异常发生,到团队理解“发生了什么、为什么发生、影响有多大”所花费的平均时间。这个时间越短,团队的“诊断”能力越强。

预测性告警占比:在所有告警中,有多少比例是在用户感知到故障之前,由系统主动预测并发出的?这个比例越高,系统的主动性越强。

决策支持准确率:系统提供的根因分析或修复建议,有多少次被证明是正确的?这直接衡量了“洞察”的质量。

凌晨三点,那个运维工程师的手机依然会亮起。但屏幕上的信息不再是冰冷的“CPU > 85%”,而是一条清晰的洞察:“检测到订单服务因缓存穿透,导致数据库压力骤增,已自动启用本地降级策略,业务影响轻微。根本原因分析与修复建议已生成,请安排明日评审。”

那一刻,他不再是一个被警报奴役的“救火队员”,而是一个掌控系统、预见风险的“系统驾驭者”。他的价值,也从被动地“让系统不出事”,升华到了主动地“让系统更健壮、更可理解”。

真正的监控,其终极目的不是用红色黄色填满屏幕,制造紧张。而是在纷繁复杂的比特洪流中,为团队点亮一盏明灯,照亮系统的内在逻辑与运行轨迹,将未知的恐惧,转化为已知的、可应对的挑战。这,就是从“制造警报”到“生产洞察”的深远意义。