云上配置管理实战:别再让配置错误背锅

去年一个客户,半夜三点打电话过来,声音发抖:“系统崩了,所有服务都连不上数据库。”

我问:“最近改了啥?”

“就改了一行配置,把连接池从50改到200,想提升性能。改完重启,就崩了。”

改配置的同事很委屈:“我就改了一个数字,怎么会崩?”

这是很多运维人员的共同经历:改了一行配置,整个系统塌了。改的人一脸无辜,背锅的永远是配置。

今天聊聊云上配置管理。不是那种“配置要规范”的废话,而是帮你理清楚:配置为什么总出事?怎么管才能不乱?怎么让配置变更不再心惊胆战?

01 为什么一行配置能搞崩系统?

那行连接池配置,从50改到200。看起来只是数字变大。但后果是:每个应用实例会向数据库申请200个连接。10个实例就是2000个连接。数据库的max_connections只有500。连接数超了,数据库拒绝新连接,所有服务全崩。

这不是配置的错,是没有算清楚“配置改动的连锁反应”。

配置之所以容易出事,有三个原因:

第一,配置影响范围大。 改一个数字,可能影响整个集群、整个数据库、甚至整个业务链路。

第二,配置和环境强相关。 开发环境好用的配置,生产环境不一定行。测试环境连接池50够用,生产流量大10倍,200也许还不够。但直接改成200,又可能打爆数据库。

第三,配置和代码分离。 代码改了要经过测试、审核、发布流程。配置改了,可能直接生效,没人review,没人测试。

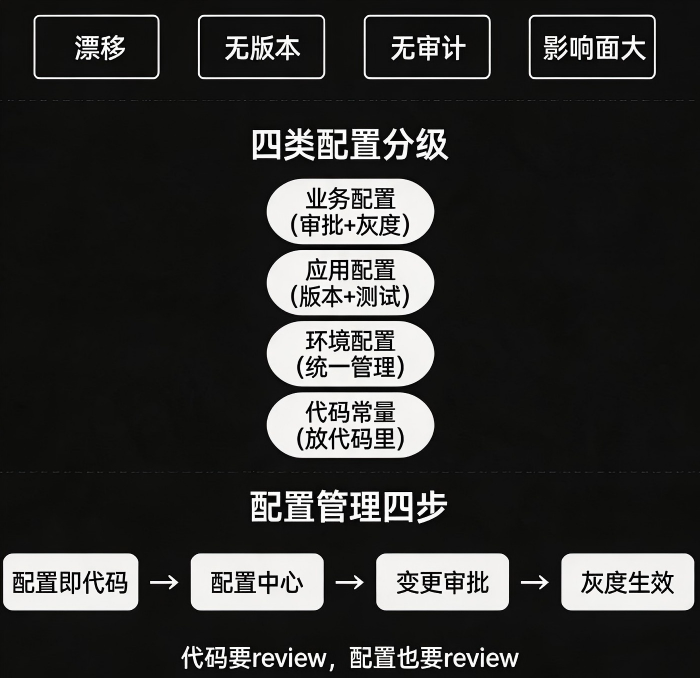

02 配置的三大坑

坑一:配置漂移

你说服务器配置都统一了。某天排查问题发现,三台机器里有一台配置文件不一样。谁改的?不知道。什么时候改的?不记得。

这就是配置漂移。一台机器走了,配置就乱了。

坑二:配置无版本

改了一行配置,系统崩了。想回滚,发现忘了改回来的是哪个值。没有历史记录,没有版本管理,回滚靠“我记得好像是50”。

坑三:配置无审计

领导问:“上周谁改了限流阈值?”你说:“不知道,没记。”改了没人知道,出事了找不到人。

这些坑,不是某个人的问题,是制度问题。没有流程,没有工具,全靠记性和自觉,迟早出事。

03 配置分类:不是所有配置都一样

配置不能一刀切。按影响范围和变更频率,分四类。

第一类:业务配置(如促销折扣、限流阈值)。影响大,变化频繁。需要审批流程,需要灰度发布。改了先上1台机器观察,没问题再全量。

第二类:应用配置(如日志级别、连接池大小)。影响中,变化较少。需要版本管理,需要测试环境验证。改了要能回滚。

第三类:环境配置(如数据库地址、缓存地址)。影响大,变化少。建议用环境变量或配置中心统一管理,不要写死在代码里。

第四类:代码常量(如数学公式中的系数)。基本不变。这类应该放在代码里,不是配置里,避免被乱改。

04 配置管理的四个最佳实践

实践一:配置即代码

把配置文件放进Git,和代码一起管理。改配置要走PR,有人review,有历史记录,能回滚。

Terraform、Ansible、Kubernetes的YAML,都是配置即代码的实践。

实践二:使用配置中心

云上配置管理,用配置中心代替本地文件。

优势:配置变更实时生效,不用重启应用

优势:一个地方管理所有环境的配置

优势:支持灰度发布(先推1台机器,观察没问题再全量)

云上工具:AWS AppConfig、ACM(AWS Config Management)、阿里云ACM、Nacos

实践三:配置变更审批

高风险配置(如连接池、限流阈值、数据库连接数)必须审批。

谁申请、谁审批、什么时候改、怎么回滚

审批通过后,自动推送到配置中心

变更记录自动归档,审计可查

实践四:配置变更演练

配置变更也要演练。在生产环境先改一台机器,观察半小时。没问题再全量。

那家改连接池的客户,如果先在1台机器上改成200,观察数据库连接数变化,就不会直接打爆数据库。

05 一个真实案例

某公司,运维为了应对大促,把限流阈值从1000改到5000。没走审批,没做灰度,直接全量推。

大促开始,流量上来,数据库没扛住,因为限流没生效——配置改了,但应用没重启,老配置还在生效。大促一半才发现,改完忘重启了。

损失:大促前两小时几乎无法下单。

后续改进:

配置中心,变更实时生效,不需要重启

高危配置走审批流程

变更前必须测试环境验证

生产环境灰度发布,先推1台观察

运维负责人说:“以前觉得改配置是小事,现在觉得和改代码一样严肃。”

写在最后

配置管理,听起来不像高可用、容灾那么高大上。但出事的频率,比那些高多了。

那位运维负责人后来总结:“代码跑错了,顶多500错误。配置改错了,整站都起不来。”

配置也配错了。代码要review,配置也要review。代码要版本管理,配置也要版本管理。代码要灰度发布,配置也要灰度发布。

下次改配置之前,问自己三个问题:

这个配置影响多大?

能不能先改一台试试?

改错了怎么回滚?

想清楚再动手。