别再数告警数量了:衡量安全运营效能的五个“反常识”指标

周一晨会上,安全主管指着大屏幕上的数据,语气中带着自豪:“上周我们的安全团队处理了2573条告警,平均响应时间4.2分钟,拦截了189次潜在攻击。”会议室里响起稀疏的掌声。但角落里,一位刚值完夜班的分析师低声对同事说:“这2573条里,有2400条是同一个误报规则产生的,我们手动点了2400次‘忽略’。”

这个故事每天都在无数安全团队里上演。我们用告警数量证明自己“很忙”,用响应时间标榜自己“高效”,却很少有人问一个更根本的问题:这些数字,真的说明我们的安全变好了吗?

更讽刺的是,告警越多,往往意味着防御能力越弱——要么是检测规则质量低下,要么是攻击面过大,要么是攻击者正在疯狂试探。而“平均响应时间”这个指标,则完美地隐藏了一个事实:我们可能只是越来越熟练地关闭误报,而对真正的威胁视而不见。

今天,我想和你分享五个“反常识”的指标。它们不会出现在你的SIEM仪表盘默认模板里,却能真正告诉你:你的安全运营,到底是在假装高效,还是在变强。

指标一:未被处理的告警占比

反常识点:关注那些“没响应的”,比关注“响应了的”更重要。

大多数团队痴迷于“响应率”——处理了多少告警。但真正危险的,是那些被忽略、被遗漏、甚至从未进入分析师视野的告警。它们可能因为“太安静”而被自动化规则过滤,可能因为“太多了”而被分析师跳过,也可能因为“看着像误报”而被经验直觉忽略。

而攻击者最擅长的,恰恰是藏在这些缝隙里。

如何衡量:

计算在总告警量中,有多少是因容量饱和而被直接丢弃的,有多少是虽被存储但从未被人工查看的,有多少是“标记为已读”但实际未做深度研判的。这个比例,才是你真实防御盲区的投影。

数据支撑:根据M-Trends 2023报告,攻击者的平均驻留时间中位数是16天。这16天里,攻击者产生的告警,很可能就在你的“未被处理”清单里躺着。

指标二:自动化处置闭环率

反常识点:自动化不是为了“省事”,而是为了“闭环”。自动化不是终点,闭环才是。

很多团队引入SOAR(安全编排自动化与响应)后,自豪地宣布:“我们80%的告警由自动化处理了!” 但仔细一看,这个“处理”往往只是“创建了一个工单”或“发了一条通知”。告警的生命周期并没有真正结束,只是从一个队列转移到了另一个队列。

真正的自动化处置,必须满足三个条件:

动作已执行:比如自动封锁了IP、隔离了主机、重置了账号。

结果已验证:系统确认了动作生效,威胁被阻断。

证据已留存:整个过程的日志和上下文被妥善归档。

只有同时满足这三项,才算一个“闭环”。

如何衡量:

计算真正完成“检测-分析-决策-执行-验证”全流程自动化的告警比例。这个比例越高,说明你的自动化不是“面子工程”,而是真正解放了人力。

指标三:威胁狩猎的有效发现率

反常识点:真正的高级威胁,不是等来的,是“找”出来的。

告警是被动的——你在等系统告诉你“出事了”。而威胁狩猎是主动的——你在假设“已经出事了”,然后像侦探一样去寻找蛛丝马迹。一个成熟的安全团队,不应该把所有时间都花在响应告警上,而应该预留固定的精力用于主动狩猎。

但“主动狩猎”很容易变成“随机扫日志”,变成另一种形式的无效忙碌。所以需要衡量它的产出。

如何衡量:

计算每次威胁狩猎活动(或每10小时狩猎工时)中,发现的真正有价值、且未被现有检测规则覆盖的威胁或漏洞数量。如果连续多次狩猎零发现,要么是你运气太好,要么是你的狩猎方法有问题。

真实案例:某金融科技公司强制要求每位安全分析师每周拿出4小时进行威胁狩猎,并记录发现。半年后,他们发现了17个规则未覆盖的攻击模式,其中3个是已经潜伏超过30天的持续性威胁。

指标四:误报对真实告警的“淹没率”

反常识点:误报的危害,不在于它本身,而在于它让真实威胁“失声”。

我们都知道误报率高不好,但传统的“误报率”指标(误报数量/总告警数量)其实很模糊。100个告警里有90个误报,和10000个告警里有9000个误报,误报率都是90%,但对分析师的影响天差地别。

更有意义的衡量方式,是看误报与真实告警的绝对数量比值。假设真实告警每天只有10条,而误报有1000条,那么分析师每看到1条真实告警,就要先翻过100条误报的垃圾山。这种“淹没效应”才是误报的真正杀伤力。

如何衡量:

计算“误报/真实告警”的倍数。如果这个倍数超过50倍,意味着你的检测规则需要紧急优化——不是因为“太吵”,而是因为“听不见”。

指标五:调查深度评分

反常识点:处理告警很快,不等于解决问题很深。

这是最难量化、但最能反映团队真实水平的指标。当一个告警被“处理”后,留下的信息质量如何?是简单地写一句“误报,关闭”,还是留下了完整的调查轨迹?

我建议引入一个简单的 “深度评分”体系:

0分:仅标记为已处理,无任何注释。

1分:有注释,但仅重复告警内容(如“确认是CPU高”)。

2分:记录了初步调查动作(如“已查进程列表,未发现异常”)。

3分:有明确的根因结论(如“确认是监控agent自身bug导致,已升级版本”)。

4分:除根因结论外,还提出了规则优化或系统加固建议,并创建了跟踪任务。

每月统计团队的平均调查深度评分,你会发现:那些“很忙”的团队,评分可能集中在1-2分;而那些真正在进步的团队,评分在持续向3-4分靠近。

用新指标,重建安全运营的“北极星”

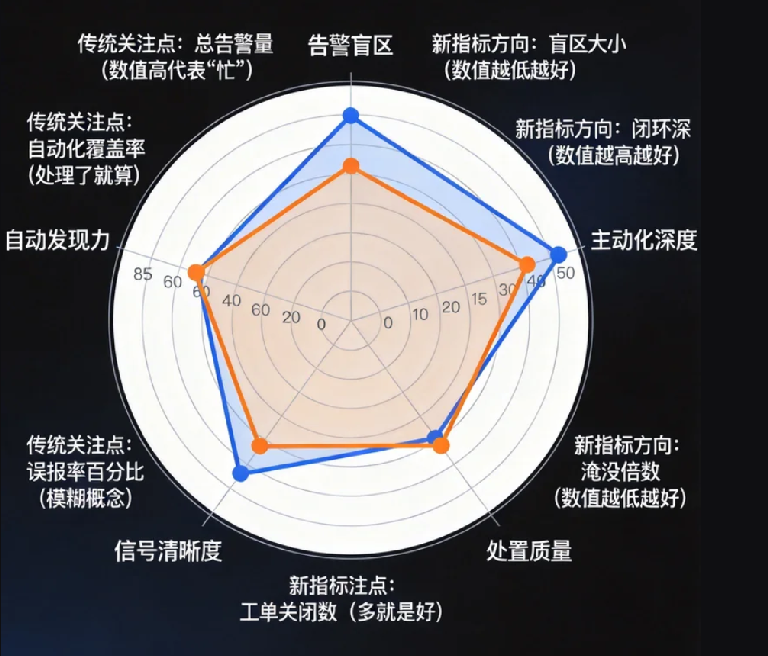

传统的告警数量、响应时间,就像汽车的里程表和时速表——它们告诉你“开了多远”和“开得多快”,却无法告诉你“方向对不对”。

而上面这五个指标——未被处理的告警占比、自动化闭环率、威胁狩猎发现率、误报淹没率、调查深度评分——共同指向一个更根本的问题:我们的安全能力,是在变强,还是在假装变强?

当你开始追踪这些“反常识”指标时,一个有趣的变化会发生:团队的注意力从“处理下一个告警”转移到“让下一个告警变得更好”。分析师不再满足于快速关闭工单,而是会主动优化规则、记录调查轨迹、思考如何防止同类问题复发。

这才是安全运营的终极目标——不是越来越擅长“救火”,而是让火越来越难烧起来,让每一场火都留下防火经验。

所以,下周的晨会上,当有人再次炫耀“我们这周处理了3000条告警”时,你可以微笑着问一句:

“很好。那有多少是真的?有多少被彻底解决了?我们从中学会了什么?”

真正的安全效能,藏在这些问题的答案里,而不是那些漂亮的数字里。