数据库性能瓶颈诊断:从磁盘IO、内存调优到云托管服务选型

下午两点,在线高峰刚刚开始,监控系统突然炸了:订单接口响应时间从50ms飙到3秒。你登录数据库服务器,一看系统负载——CPU不高,内存充足,但磁盘I/O等待那一项,红得刺眼。

你陷入了所有技术负责人都会遇到的困境:数据库慢,但不知道慢在哪。

加内存?已经64GB了。换SSD?已经是NVMe了。上云托管数据库?老板问“多少钱”的时候你答不上来。

今天我们聊聊怎么系统性地诊断数据库性能瓶颈——从磁盘I/O到内存调优,再到什么时候该认输,把数据库交给云服务商。

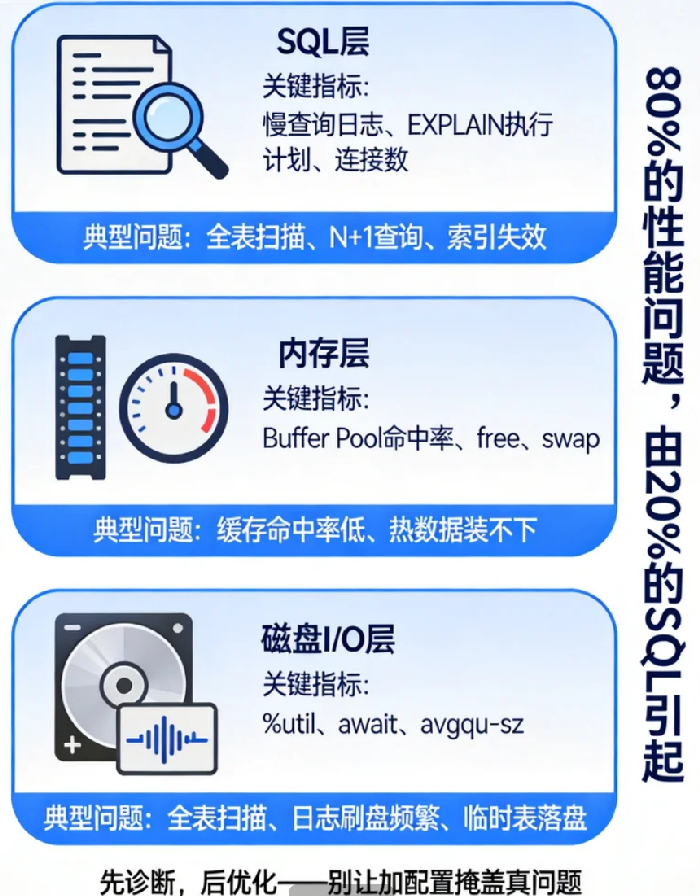

01 数据库性能的三层架构

把数据库想象成一栋楼:

底层是地基:磁盘I/O。数据最终要落到磁盘,不管内存有多大,总有落盘的时候。

中间是仓库:内存。MySQL的Buffer Pool、PostgreSQL的Shared Buffers,都是用来缓存热数据的。

顶层是门卫:SQL解析和执行计划。查询怎么写,决定了前面的地基和仓库用得好不好。

这三层里,任何一层出问题,表现都是“数据库慢”。但诊断路径完全不同。

02 第一步:确定瓶颈在哪一层

症状一:I/O压力大

如果你的监控显示磁盘I/O使用率持续居高不下(比如超过80%),而响应延迟也远高于磁盘标称值,那么问题很可能出在I/O层。

常见原因往往是那些“吃磁盘”的操作:

全表扫描:没有索引或索引没被用上,导致大量数据被读到内存又写回磁盘。

日志刷盘太频繁:比如MySQL的InnoDB每次事务提交都强制刷盘,在高并发下会带来巨大I/O压力。

临时表用到磁盘:当内存临时表不够用时,数据库会创建磁盘临时表,这也会产生大量I/O。

这时候需要找出到底是谁在写磁盘。操作系统提供了几个实用工具(虽然命令看起来有点技术,但思路很简单):可以用工具观察哪个进程在持续写入,或者检查数据库是否在写临时文件。这些信息能帮你快速锁定问题源头。

症状二:内存吃紧

如果数据库的缓存命中率持续走低(比如低于95%),说明大部分查询没能命中内存,被迫去磁盘读取,这自然就会慢。

你可以通过数据库内置的状态变量查看缓存命中情况。如果命中率低,要么是内存真的太小,要么是访问的数据集太大,内存根本装不下。

这里有个反常识的点:内存再大,也可能I/O瓶颈。如果你的数据访问模式导致大量缓存未命中(比如随机点查但总数据量远大于内存),磁盘I/O会成为硬瓶颈。16GB的Buffer Pool存不下200GB的表,加再多内存也只能多缓存一部分,无法彻底解决。

症状三:CPU高但I/O低

这种情况通常是计算密集型或糟糕的SQL导致的——比如没有加索引的关联查询、复杂的聚合计算,或者短时间内大量连接建立销毁。这时应该把目光投向慢查询日志,找出那些消耗CPU的“坏”SQL。

03 第二步:针对性优化

磁盘I/O优化

硬件层:如果预算允许,从普通SSD升级到NVMe SSD,IOPS可以提升一个数量级。对于核心数据库,可以考虑将数据和日志分开存放在不同的物理磁盘上,减少竞争。

操作系统层:选择合适的文件系统(比如XFS通常优于ext4),调整挂载参数(如启用noatime避免记录访问时间),这些都能减少不必要的I/O。

数据库层:根据磁盘能力调整I/O相关参数。比如MySQL的innodb_io_capacity可以告诉InnoDB你的磁盘有多快,默认值200远低于现代SSD的能力。另外,适当增大日志文件大小、调整刷盘策略(允许丢失少量数据换取更高性能)也能有效缓解I/O压力。

内存优化

核心原则很简单:让热数据尽量留在内存里。

对于MySQL,innodb_buffer_pool_size通常可以设为可用内存的70%-80%,留一部分给操作系统缓存和其他进程。对于PostgreSQL,shared_buffers一般设为内存的25%(因为PG更依赖操作系统缓存)。

但请记住:加内存不能解决所有问题。如果业务特征就是“扫描大量数据但只用一小部分”(比如每晚跑报表),Buffer Pool再大也帮不上忙。这种场景需要从SQL或架构层面优化——比如改用列存、数据分层等。

SQL与应用层优化

这是性价比最高的优化,也是最容易被忽视的。

定期分析慢查询日志,找出最差的几条SQL。

用

EXPLAIN看执行计划,全表扫描是头号杀手。警惕N+1查询:在循环里查数据库,等于自杀。

一个小实践:每天花十分钟看一次慢查询日志,优化最差的那条。坚持一个月,性能至少翻倍。

04 第三步:什么时候该上云托管服务

自己调优了三个月,该做的都做了,还是慢。这时候,云托管数据库就成了一个值得考虑的选择。

托管数据库的优势

硬件不用操心:底层是云厂商优化过的存储,IOPS可预置,扩展方便。

参数预调优:RDS、CloudSQL等服务的默认参数通常比自己乱配的更合理。

只读实例一键创建:读写分离轻松实现。

备份恢复自动化:时间点恢复、跨区域复制,比自己搭便宜且可靠。

托管数据库的代价

黑盒:你看不到物理I/O、操作系统指标,有些问题没法深入诊断。

规格锁定:IOPS往往和内存、CPU绑定,有时候你需要高IOPS但不需要大内存,也得一起买。

成本:长期稳定运行的话,自己调优好的数据库比托管服务便宜。

选型决策框架

问自己三个问题:

团队有专职DBA吗?

没有 → 托管数据库是更安全的选择。

有 → 自建可以精细化调优,但需要持续投入。

性能要求极致吗?(比如P99 < 10ms)

是 → 自建 + 本地NVMe SSD更能满足。

否 → 托管数据库够用。

业务增长可预测吗?

是 → 自建容量规划可做,成本可控。

否 → 托管数据库的弹性扩容更有优势。

05 一个真实案例

某电商公司,高峰期订单接口总是慢。他们做了三步:

诊断:发现I/O等待高,但SSD已经是顶配。他们进一步观察I/O队列深度,发现经常拥堵,说明I/O请求堆积。再看数据库内部指标,日志刷盘等待次数很高,说明日志写入跟不上。

优化:调整了日志文件大小,并放宽了刷盘策略(允许丢失最后一秒数据)。I/O压力下降60%,高峰期不再报警。

选型:半年后业务翻倍,自建扛不住了。他们评估后选了云托管数据库,因为团队只有两人,没精力再深入调优。最终性能稳定,成本比自建高30%,但人力成本省了80%。

对他们来说,这是对的。

06 最后的建议

数据库性能优化有个残酷的真相:80%的性能问题,是由20%的SQL引起的。花一周时间调内核参数,不如花一小时优化那条跑了一万次的烂SQL。

工具只是辅助:诊断I/O需要看系统负载,诊断内存看缓存命中率,诊断SQL看慢查询日志。思路比命令更重要。

一位做数据库运维十几年的朋友跟我说过一句话:“最贵的不是SSD,也不是内存,是你不知道瓶颈在哪的那几个小时。”

下次数据库慢的时候,先别急着加资源。按这三步走一遍——定位I/O、内存、SQL三层中的问题点,针对性优化。如果还不行,再考虑托管服务。

毕竟,解决问题的最高境界,是知道问题在哪。