凌晨两点,手机又响了。

你眯着眼摸到手机,屏幕上是一条告警:“订单服务响应时间超过5秒”。登录VPN,打开Grafana,CPU看起来正常,内存也够。再看日志,一堆Error级别,但不知道是哪个请求导致的。折腾了半小时,最后发现是下游的Redis集群出了故障——而Redis的监控你根本没看。

这样的夜晚,你经历过多少次?

这不是运维,这是救火队员。火起了才冲进去,烧完了才复盘。而真正成熟的团队,追求的是防火——在火灾发生之前,就闻到烟味。

01 可观测性不是监控的升级版,是监控的颠覆版

先说清楚一个概念:可观测性(Observability)和监控(Monitoring)不是一回事。

监控是“我知道系统挂了”。可观测性是“我知道系统为什么挂”。

监控靠的是预先定义的指标和阈值——CPU超过80%就报警,磁盘满了就报警。但真实世界的故障从来不按你预设的剧本走。某个请求莫名其妙变慢、某个用户的会话总是中断、某个微服务间歇性超时——这些“未知的未知”,监控抓不住。

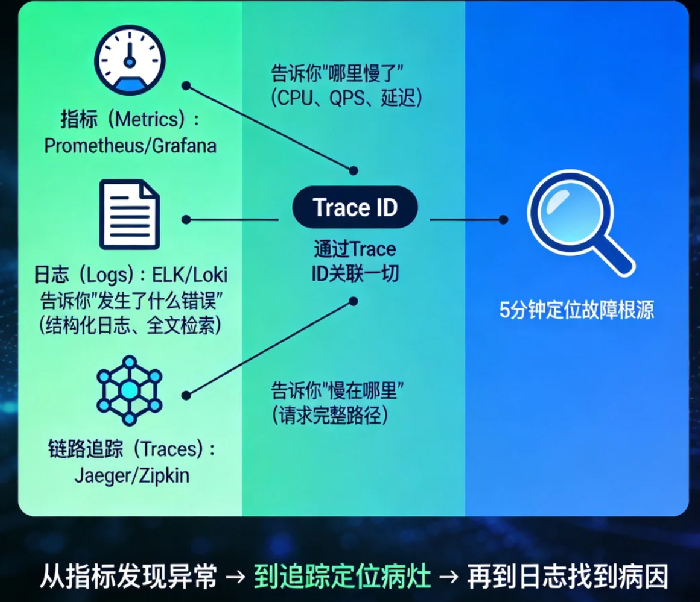

可观测性的核心思想是:让系统的内部状态可以通过外部数据来理解和探索。你不需要提前猜到所有可能的故障模式,只需要把三类数据留存好——指标(Metrics)、日志(Logs)、链路追踪(Traces)——然后在出问题时,像侦探一样顺着线索找到真相。

这三大支柱,缺一不可。

02 指标:你的“生命体征”

指标是你最先接触的监控数据:CPU使用率、内存占用、QPS、错误率、响应时间。它们是时序的、聚合的,告诉你系统“整体”的健康状况。

但指标有个天然的局限:它们丢了上下文。

比如你看到“订单服务错误率从0.1%飙升到5%”,你只知道坏了,但不知道是哪个用户、哪个接口、哪个参数导致的错误。指标只能告诉你“哪里着火”,不能告诉你“火怎么烧起来的”。

常见工具:Prometheus + Grafana 是标配。采集简单,查询灵活,可视化漂亮。

反常识:指标不是越多越好。 很多团队把能采集的都采集了,结果Grafana上几十个面板,但没人看。真正有效的指标,是那些能直接反映用户体验和业务健康度的——比如“95%线响应时间”、“购物车完成率”。内部技术指标(如goroutine数量)只在排查特定问题时有用。

03 日志:你的“黑匣子”

日志是离散的事件记录。每一行日志记录着“在某个时间点,发生了某件事”。

传统做法是把日志写在本地文件里,出问题了ssh上去grep。这在小规模还行,一旦服务器超过10台,就彻底失效了。

现代日志系统做三件事:

集中采集:用Fluentd、Logstash把各服务器日志实时收集到中心存储。

结构化:把日志从纯文本解析成字段(时间、级别、请求ID、用户ID、错误码),方便检索和聚合。

全文索引:像Elasticsearch这样的搜索引擎,让你秒级搜索TB级别的日志。

误区:日志越多越好。 有人把debug级别的日志都打开,结果一天几个TB,存储成本爆炸,真正要找的反而淹没在噪音里。正确做法是:INFO记录业务关键点,ERROR记录异常,DEBUG只在调试时临时开启。

突发性数据:一份针对200家公司的调查显示,70%的故障复盘时发现,日志里其实早就记录了征兆,只是没人去看。不是因为大家懒,是因为日志系统太难用,查一次要半天。

04 链路追踪:你的“X光片”

这是可观测性里最年轻、也最强大的支柱。

微服务架构里,一个用户请求可能经过10个服务、20次RPC调用。指标告诉你哪个服务慢了,日志告诉你每个服务报了什么错,但你还是不知道——这个请求到底经历了什么?

链路追踪(Tracing)解决了这个问题。它为每个请求分配一个全局唯一的Trace ID,然后随着请求在各服务间传递,记录下每一跳的耗时和元数据。最后把这些数据汇总,你就能看到一张完整的“请求旅程图”。

工具:Jaeger、Zipkin、SkyWalking。

反常识:你不需要追踪所有请求。 99.99%的请求都是正常的,全量追踪会带来巨大的性能开销和数据存储成本。业内实践是采样——比如只追踪1%的请求,或者只追踪出错的请求。这样既能抓住异常,又不会拖垮系统。

另一个反常识:没有Trace ID的日志,等于没记。 如果你的日志里没有Trace ID,当你发现某个请求出错时,你无法把它的错误日志关联起来,只能大海捞针。

05 整合:三支柱如何协同作战

三个支柱单独看都有价值,但真正的大杀器是把它们串起来。

设想这样一个场景:

告警触发:Grafana上看到“订单服务P99延迟从100ms飙到3s”。(指标)

点击告警,直接跳转到对应的仪表盘,看到该时段内出错的Trace列表。(链路追踪)

点进最慢的一个Trace,看到是“调用库存服务”这一步耗时2.8秒。

从Trace里拿到这个请求的Trace ID,一键跳转到日志系统,搜索该Trace ID下的所有日志。

发现库存服务返回了“连接池耗尽”的错误。(日志)

整个过程不到5分钟,而不是原来的半小时。这就是可观测性的终极形态:从指标发现异常,到追踪定位病灶,再到日志找到具体病因,无缝衔接。

要实现这种整合,技术上需要做一件事:在所有服务中传递统一的Trace ID,并把它打印到日志里。这听起来简单,但在异构系统里需要一定的规范落地。

06 告警设计:别让狼来了变成日常

有了完整的可观测性数据,下一步是用它们来触发告警。但大多数团队的告警系统是噪音制造机——动不动就报警,结果大家习以为常,真出事时反而忽略了。

静态阈值陷阱:设CPU > 80%报警,结果每天下午都短暂超过,运维把它静音了。有一天真的CPU 100%,没人注意到。

现代告警理念是基于趋势和动态基线。用机器学习学习过去30天的行为模式,当指标偏离“正常模式”时才报警。比如QPS平时平稳,突然下降20%——可能不是系统挂了,而是业务出问题了。

还有一点:告警要有上下文。 一条好的告警应该包含:什么时间、什么服务、什么指标、偏离了多少、建议去哪里看(比如Grafana面板链接、日志查询链接)。这样收到的人才能快速行动。

07 从救火到预防:不只是技术升级,更是文化转变

最后想说,可观测性建设不是买几个工具就能完成的。它需要整个研发团队改变思维方式。

以前是:写代码 -> 上线 -> 等用户投诉 -> 登录查日志。

可观测性思维是:写代码时就考虑好要暴露哪些指标、日志里要带什么上下文、如何传递Trace ID。把“可观测”作为代码的一部分,而不是事后补救。

我见过一个团队,他们在每次发布前会做“可观测性验收”:新功能上线后,能不能通过现有的仪表盘快速判断健康状况?如果出错了,能不能在5分钟内定位到原因?如果不能,就不允许上线。

这听起来严苛,但正是这种文化,让他们从“天天救火”变成了“一年难得一次重大故障”。

一位CTO朋友说过一句话:“以前我半夜被叫醒,是因为系统挂了。现在我被叫醒,是因为系统预测到明天可能会挂,让我决策要不要提前扩容。我更喜欢后者。”

从救火到预防,你缺的不是工具,是决心。